はじめに

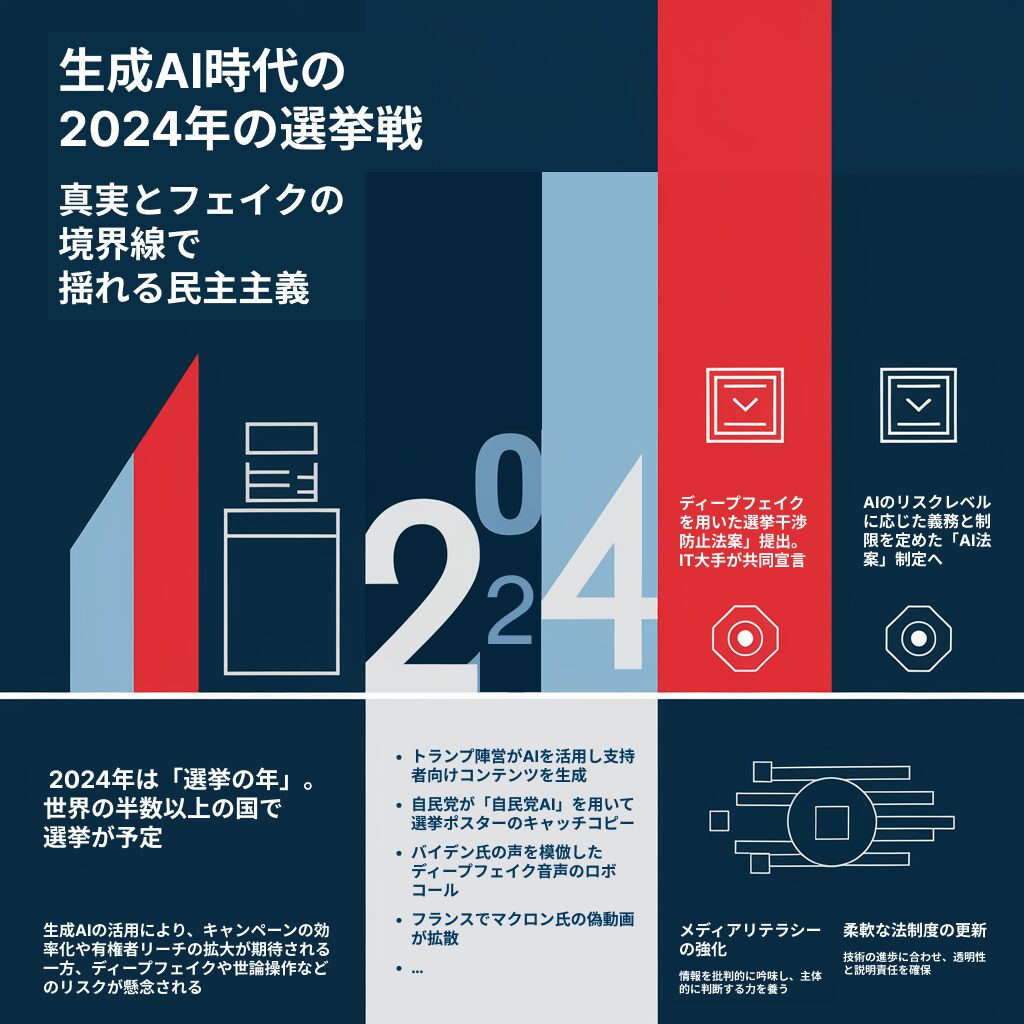

2024年は「選挙の年」と呼ばれ、世界の半数以上の国で有権者が投票に参加することが予想されています。この選挙において、人工知能(AI)、特に生成AI(GenAI)が重要な役割を果たすと考えられています。 生成AIは、情報の生産コストを低下させ、ソーシャルメディアでのコンテンツ共有を促進することで、選挙キャンペーンの手法を大きく変革しつつあります。

2024年の選挙におけるAIの重要性

2024年の選挙では、AIが選挙戦略や有権者との関わり方、そして選挙結果自体に大きな影響を与える可能性があります。 キャンペーンにおいては、有権者データの分析や個別メッセージの作成、ソーシャルメディア上での情報拡散など、AIを活用することで効率的かつ効果的な選挙活動が可能になります。また、多言語AIの発展により、地域や言語の壁を越えた有権者へのアプローチも期待されています。

しかし、AIの進化は 選挙の公正性や民主主義の基盤に対する新たな脅威 ともなり得ます。特に、ディープフェイク技術を用いた偽情報の拡散や、有権者のプライバシー侵害、世論操作などのリスクが懸念されています。2024年の選挙は、AIという強力なツールとどう向き合うかが問われる重要な局面となるでしょう。

生成AIがもたらす変革と懸念

生成AIは、大量のデータから学習し、新たなコンテンツを生成する能力を持つAIの一種です。 言語モデルや画像生成モデルの発展により、人間と遜色ないテキストや画像、音声、動画を生成することが可能になりました。この技術は、選挙キャンペーンにおいて、個別メッセージの作成やターゲット広告の配信、多言語コンテンツの生成など、様々な場面で活用されると予想されます。

一方で、生成AIには 偽情報の拡散や世論操作のリスク も伴います。ディープフェイク動画や合成音声による候補者の中傷、AIが生成した誤った選挙情報の拡散など、有権者の判断を誤らせる可能性があります。また、大量の個人データを学習することで、プライバシーの侵害や不当な差別につながる恐れもあります。

2024年の選挙は、生成AIという「諸刃の剣」とどう向き合うかが問われる重要な転換点 となるでしょう。AIがもたらす利便性と効率性を活かしつつ、リスクを最小化し、民主主義の健全性を守るための取り組みが求められています。本稿では、生成AIが選挙に与える影響について、具体的な事例や各国の対策、今後の展望を交えて考察していきます。

生成AIの選挙への活用事例

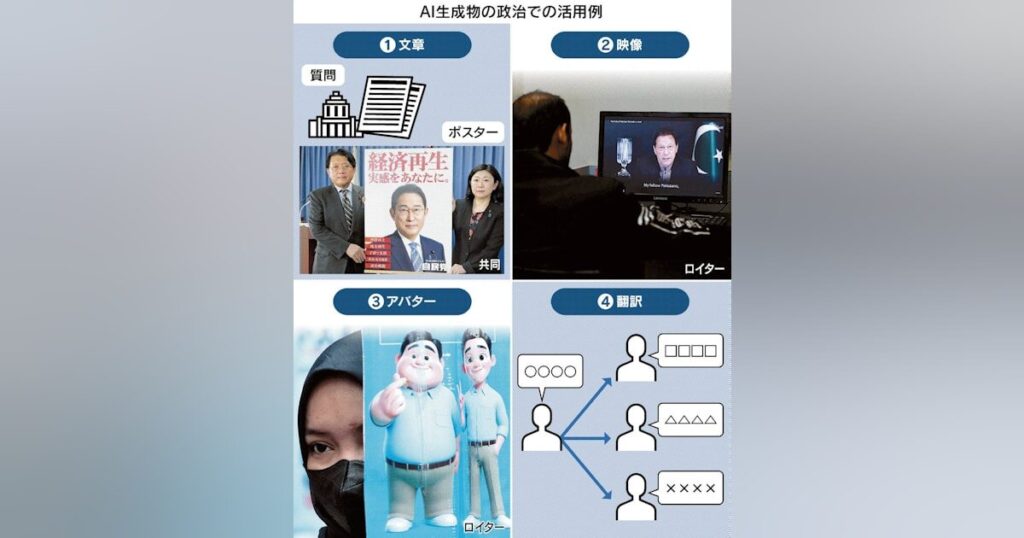

生成AIの急速な発展により、選挙キャンペーンにおける活用事例が世界各地で見られるようになりました。AIを戦略的に活用することで、候補者や政党は有権者とのコミュニケーションを効率化し、支持基盤を拡大することが可能になります。ここでは、生成AIの選挙への主な活用事例として、キャンペーン戦略の効率化とパーソナライズ、多言語対応による有権者リーチの拡大、選挙管理の自動化と高度化について詳しく見ていきます。

キャンペーン戦略の効率化と個別化

生成AIを活用することで、選挙キャンペーンの戦略立案や有権者とのコミュニケーションを効率化することができます。AIを用いてデータを分析し、有権者の嗜好や行動パターンを把握することで、より効果的なメッセージやターゲット広告を作成できます。また、チャットボットやバーチャルアシスタントを導入することで、有権者からの問い合わせに24時間365日対応可能になり、候補者と有権者の距離を縮めることができます。

米国の事例では、ドナルド・トランプ陣営がAIを活用して支持向けのコンテンツを生成し、親近感を高める戦略を採用しました。日本でも、自民党が独自の「自民党AI」を用いて新しい選挙ポスターのキャッチコピーを作成するなど、生成AIを選挙戦略に取り入れる動きが見られます。

多言語対応による有権者リーチの拡大

生成AIの多言語対応能力を活用することで、候補者や政党は言語の壁を越えて幅広い有権者にアプローチすることができます。特に、多言語・多民族国家においては、AIによる自動翻訳や多言語コンテンツ生成が選挙戦略上の重要な武器となります。

インドでは、与党インド人民党(BJP)がAIを用いてヒンディー語の演説を地域の言語に翻訳し、ソーシャルメディアで配信することで支持基盤の拡大を図っています。また、AAPI Victory Allianceなどの団体は、AIを活用して選挙メッセージを多言語に翻訳し、アジア系アメリカ人有権者へのアプローチを強化しています。

生成AIの選挙への活用は、キャンペーン戦略の高度化、有権者リーチの拡大、選挙管理の効率化など、多岐にわたる可能性を秘めています。 一方で、AIの悪用によるリスクも懸念されており、適切な活用とリスク管理のバランスが求められます。次の章では、生成AIがもたらす課題について詳しく見ていきます。

選挙に対して生成AIがもたらすリスクと課題

生成AIの選挙への活用が広がる一方で、その悪用によるリスクと課題も浮上しています。特に懸念されるのが、ディープフェイクによる誤情報の拡散、世論操作とターゲティング広告の危険性、プライバシーとセキュリティの脅威です。これらの課題に対処することは、選挙の公正性と民主主義の健全性を守る上で不可欠です。

ディープフェイクによる誤情報の拡散

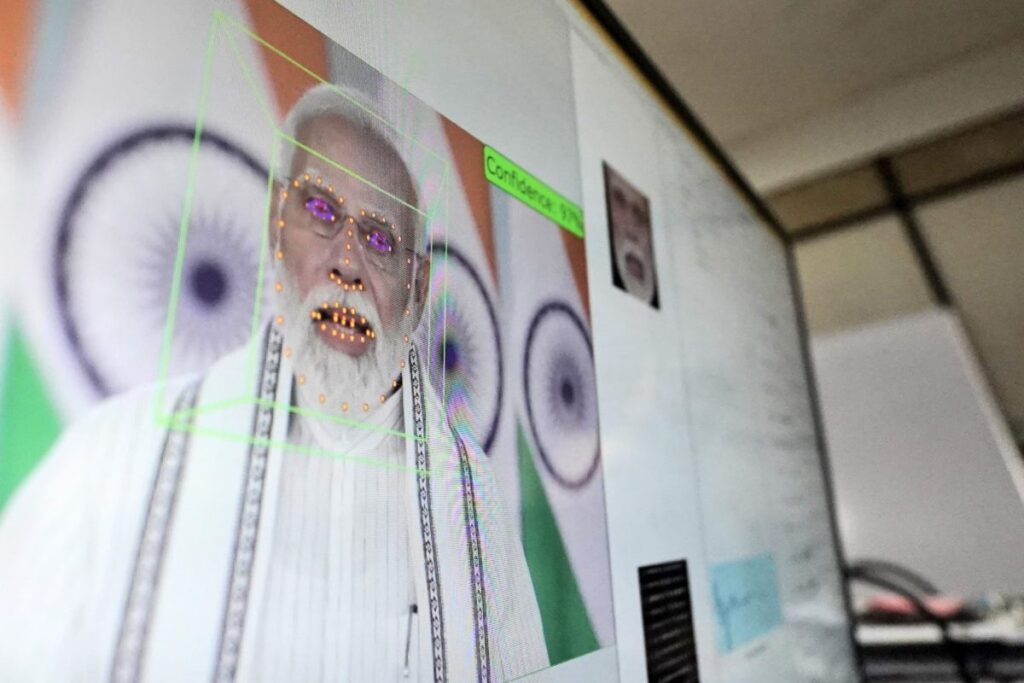

ディープフェイク技術の進展により、候補者や政治家の発言を巧妙に操作した動画や音声が作成され、有権者を欺く可能性が高まっています。 偽のスキャンダルや中傷情報が、ソーシャルメディアを通じて瞬時に拡散されることで、選挙結果に大きな影響を与える恐れがあります。

2024年の米国大統領選挙では、バイデン大統領の声を模倣したディープフェイク音声(ロボコール)が用いられ、投票を控えるよう有権者に呼びかける事例が報告されました。また、フランスでは、マリーヌ・ル・ペン候補の偽の動画が拡散され、選挙戦に混乱をもたらしました。ディープフェイクは、有権者の判断を誤らせ、選挙の信頼性を損なう深刻な脅威となっています。

世論操作とターゲティング広告の危険性

生成AIを悪用することで、特定の候補者や政党に有利になるような世論操作が行われる可能性があります。 ソーシャルメディア上で大量の偽アカウントを作成し、AIが生成した誤情報を拡散することで、有権者の認識をゆがめることができます。

また、AIを用いて有権者のデータを分析し、個人の嗜好や行動パターンに合わせたターゲティング広告を配信することで、ステルスマーケティングによる投票行動の操作が懸念されます。 米国では、2016年の大統領選挙でケンブリッジ・アナリティカ社が有権者データを不正利用し、世論操作を行った疑惑が浮上しました。生成AIの発展により、こうした世論操作の手法はより巧妙化していくと予想されます。

プライバシーとセキュリティの脅威

生成AIの学習には大量の個人データが必要であり、有権者のプライバシー保護が重要な課題となっています。 不適切なデータ収集や管理により、有権者の機微な情報が流出したり、不当な差別に利用されたりする恐れがあります。

また、AIシステムのセキュリティ対策が不十分な場合、サイバー攻撃によってデータが改ざんされたり、選挙インフラがマヒしたりするリスクがあります。 2016年の米国大統領選挙では、ロシアによるハッキングや偽情報拡散が問題となりましたが、生成AIの登場によって、こうした脅威はさらに高度化すると予想されます。

生成AIは、選挙における情報戦の様相を大きく変えようとしています。ディープフェイク、世論操作、プライバシー侵害など、AIがもたらすリスクに対処するためには、技術的対策だけでなく、法規制や倫理ガイドラインの整備、有権者教育の強化など、多角的なアプローチが求められます。 次の章では、各国の事例を踏まえながら、生成AIのリスクに対する具体的な対策について考察します。

選挙における生成AIの各国の事例と対策

生成AIが選挙に与える影響は世界的な関心事であり、各国が独自のアプローチでリスクに対処しようとしています。ここでは、主要国である米国、EU、インド、日本の事例を取り上げ、規制の動向や技術的対策、AIの活用事例などを比較検討します。

米国:規制の動向とtech企業の取り組み

米国では、生成AIを悪用した選挙干渉への懸念が高まる中、連邦議会を中心に法規制の議論が活発化しています。 2024年1月には、「ディープフェイクを用いた選挙干渉防止法案」が提出され、虚偽の情報拡散に対する罰則の強化などが盛り込まれました。また、カリフォルニア州を始めとする19の州が、選挙期間中のディープフェイク使用を禁止または制限する法律を制定しています。

一方、IT大手各社も自主的な取り組みを進めています。Google、Microsoft、Metaなど20社が、「AIと選挙の安全に関する共同宣言」を発表し、生成AIによる偽情報や操作コンテンツに対する対策で連携することを約束しました。OpenAIは、自社のAIモデルを選挙活動に使用することを禁止する方針を打ち出しました。

EU:AIガバナンスの枠組みと法整備

EUでは、生成AIを含むAIシステム全般を包括的に規制するための法的枠組み「AI法案」の制定を進めています。 2024年4月に欧州議会で承認されたこの法案は、AIシステムのリスクレベルに応じた義務と制限を定めており、選挙への悪用防止にも重点が置かれています。

また、2024年6月の欧州議会選挙を控え、欧州委員会は「選挙偽情報対策ガイドライン」を発表しました。これにより、ソーシャルメディア企業に対して、ディープフェイクの検出やラベリングを義務付けるとともに、選挙期間中の監視体制強化を求めています。 違反した場合には巨額の制裁金が科される可能性があります。

日本:法規制の検討状況と今後の展望

日本では、2024年の衆院選を見据え、政府がAIによる選挙への影響を検討するための有識者会議を立ち上げました。 会議では、ディープフェイクなどのAI悪用への罰則強化や、インターネット広告の規制の在り方などが議論されています。

一方で、AIの社会実装を促進する観点から、規制と技術振興のバランスを取ることの重要性も指摘されています。自民党は「AI推進基本法案」の制定を目指しており、 公平性・透明性・説明責任の確保を前提としつつ、AIの開発と活用を後押しする方針を打ち出しました。

各国の事例からは、生成AIのリスクに対処するための法規制と技術的対策の両輪が求められること、そして国際的な連携の必要性が浮かび上がります。AIと民主主義の健全な関係を築くためには、政府・企業・市民社会が協調し、包括的なガバナンスの枠組みを構築することが不可欠です。次章では、この点に関する具体的な提言を行います。

おわりに: 持続的な生成AI活用と民主主義を守るために

本稿では、2024年の選挙を前に、生成AIが民主主義に与える影響について考察してきました。生成AIは、選挙キャンペーンの効率化や有権者とのエンゲージメント向上など、様々な可能性をもたらす一方で、ディープフェイクによる誤情報の拡散や世論操作、プライバシー侵害など、深刻なリスクも内包しています。各国の事例からは、法規制と技術的対策の両輪、国際連携の必要性、包括的ガバナンスの重要性などが浮かび上がりました。

生成AIと民主主義の未来

生成AIの急速な発展は、民主主義のあり方そのものを問い直す契機となるかもしれません。AIがもたらす利便性と効率性を追求するあまり、人間の尊厳や自由、多様性といった民主主義の根幹的な価値が損なわれてはなりません。 同時に、AIの力を適切に活用することで、より多くの市民の声を政治に反映させ、社会的課題の解決を加速させることも可能です。

生成AIがもたらす誤情報やディープフェイクに対抗するためには、有権者一人一人がメディアリテラシーを身につけ、情報を批判的に吟味する能力を養うことが重要です。 学校教育や社会教育の場において、以下のようなメディアリテラシー教育を強化する必要があります。

- AIリテラシーの育成: 生成AIの仕組みや特性、リスクについての基本的な知識を身につける。

- 情報の評価スキルの向上: 情報の信頼性を見極め、ファクトチェックする習慣を身につける。

- 倫理的判断力の養成: AIがもたらす倫理的課題について考え、主体的に判断する力を養う。

私たちは、AIを民主主義の脅威ではなく、その発展のための機会と捉え、主体的に付き合っていく必要があります。そのためには、政府、企業、市民社会、国際社会が知恵を出し合い、AI時代にふさわしい民主主義のビジョンを共創していくことが求められます。

技術の活用とリスク管理のバランス

生成AIの選挙への影響を考える上で、技術の活用とリスク管理のバランスをいかに取るかが重要な課題となります。AIの開発と利用を過度に規制することは、イノベーションを阻害し、社会の発展を妨げかねません。 その一方で、AIの悪用を放置することは、民主主義の根幹を揺るがしかねないリスクをはらんでいます。

ここで求められるのは、AIのポテンシャルを最大限に引き出しつつ、そのリスクを最小限に抑えるための、賢明なガバナンスのあり方です。技術の進歩に合わせて法制度を柔軟に更新し、AIの透明性や説明責任を確保する。メディアリテラシー教育を通じて、有権者のレジリエンスを高める。ステークホルダー間の対話と協調を促進し、包括的な対策を講じる。こうした地道な取り組みの積み重ねこそが、生成AIと民主主義の健全な関係を築く鍵となるでしょう。

2024年の選挙は、生成AIがもたらす変革の序章に過ぎません。民主主義の未来は、AIとどう向き合うかという私たち一人一人の選択にかかっています。 技術の力を活かしつつ、普遍的な価値を守り抜く知恵が、いま私たちに問われているのです。

調査手法について

こちらの記事はデスクリサーチAIツール/エージェントのDeskrex.AIを使って作られています。DeskRexは市場調査のテーマに応じた幅広い項目のオートリサーチや、レポート生成ができるAIデスクリサーチツールです。

調査したいテーマの入力に応じて、AIが深堀りすべきキーワードや、広げるべき調査項目をレコメンドしながら、自動でリサーチを進めることができます。

また、ワンボタンで最新の100個以上のソースと20個以上の詳細な情報を調べもらい、レポートを生成してEmailに通知してくれる機能もあります。

ご利用をされたい方はこちらからお問い合わせください。

また、生成AI活用におけるLLMアプリ開発や新規事業のリサーチとコンサルティングも受け付けていますので、お困りの方はぜひお気軽にご相談ください。

市場調査やデスクリサーチの生成AIエージェントを作っています 仲間探し中 / Founder of AI Desk Research Agent @deskrex , https://deskrex.ai

コメント